网站的建设不仅仅是为了发布内容,元数据的精心调整也不是为了好玩;所有这些活动协同工作,让您的页面更容易被人们发现。多年来,Google搜索一直是获得这种曝光度的主要入口,这在很大程度上要归功于其网络爬虫。

自20世纪90年代末以来,Googlebot和其他传统爬虫一直在扫描网站、获取HTML页面并为其建立索引,帮助人们找到他们想要的内容。截至2024年1月,Google占据了美国所有网络流量的63%,由前170个域名驱动。

但现在,根据麦肯锡的一项调查,一半的客户现在转向ChatGPT、Claude、Gemini或Perplexity等AI工具获取即时答案,甚至Google也在通过AI概述等功能将AI生成的摘要融入搜索结果。

这些新的AI驱动体验的背后,是一类日益增长的机器人——AI爬虫。如果您运营一个WordPress网站,了解这些爬虫如何访问和使用您的内容比以往任何时候都更加重要。

什么是AI爬虫?

AI爬虫是自动化的机器人,会扫描公开可访问的网页,类似于搜索引擎爬虫,但目的不同。它们不是为了传统排名而索引页面,而是收集内容来训练大型语言模型或为AI生成的响应提供最新信息。

从广义上讲,AI爬虫分为两类:

- 训练爬虫,如GPTBot(OpenAI)和ClaudeBot(Anthropic),收集数据来教大型语言模型更准确地回答问题。

- 实时检索爬虫如ChatGPT-User在有人提出需要最新数据的问题时实时访问网站,例如查看产品描述或阅读文档。

其他爬虫,如PerplexityBot或AmazonBot,正在构建自己的索引或系统,以减少对第三方来源的依赖。虽然他们的目标不同,但他们都有一个共同点:获取并读取来自您这样网站的内容。

AI爬虫的工作原理

当AI爬虫访问您的网站时,通常会执行以下操作:

- 向页面的URL发送基本的GET请求(无交互、滚动或DOM事件)。

- 只获取服务器返回的初始HTML。不等待客户端JavaScript加载或执行。

- 提取所有

<a href="">、<img src="">、<script src="">和其他资源链接,然后将内部(有时是外部)URL添加到其爬取队列中。在很多情况下,它还会访问返回404错误的损坏链接。 - 可能尝试获取链接的资源,如图像、CSS文件或脚本,但仅作为原始资源,而不是为了渲染页面。

- 对发现的链接递归重复此过程,以绘制出网站的地图。

AI爬虫如何与WordPress网站互动

WordPress是一个服务器端渲染平台,使用PHP在将完整HTML页面发送到浏览器之前生成它们。当爬虫访问WordPress网站时,它通常可以在HTML响应中获取所需的一切(内容、标题、元数据、导航)。

这种服务器渲染结构使大多数WordPress网站自然地对爬虫友好。无论是Googlebot还是AI爬虫,它们通常可以扫描您的网站并轻松理解您的内容。事实上,易于抓取的内容是WordPress在传统搜索和更新的AI驱动平台中表现出色的原因之一。

您是否应该允许AI爬虫访问您的内容?

AI爬虫默认已经可以读取大多数WordPress网站。真正的问题是您想让它们访问什么——以及如何控制这种可见性。

以内容驱动的企业目前正在热议这个话题。这个话题延伸到了博客文档、落地页……实际上是为网络编写的任何内容。您可能听说过“为机器写作”这样的建议,因为AI平台越来越多地抓取实时数据,在某些情况下还会包含来源链接。我们都希望出现在LLM输出中,就像希望出现在Google搜索结果中一样。

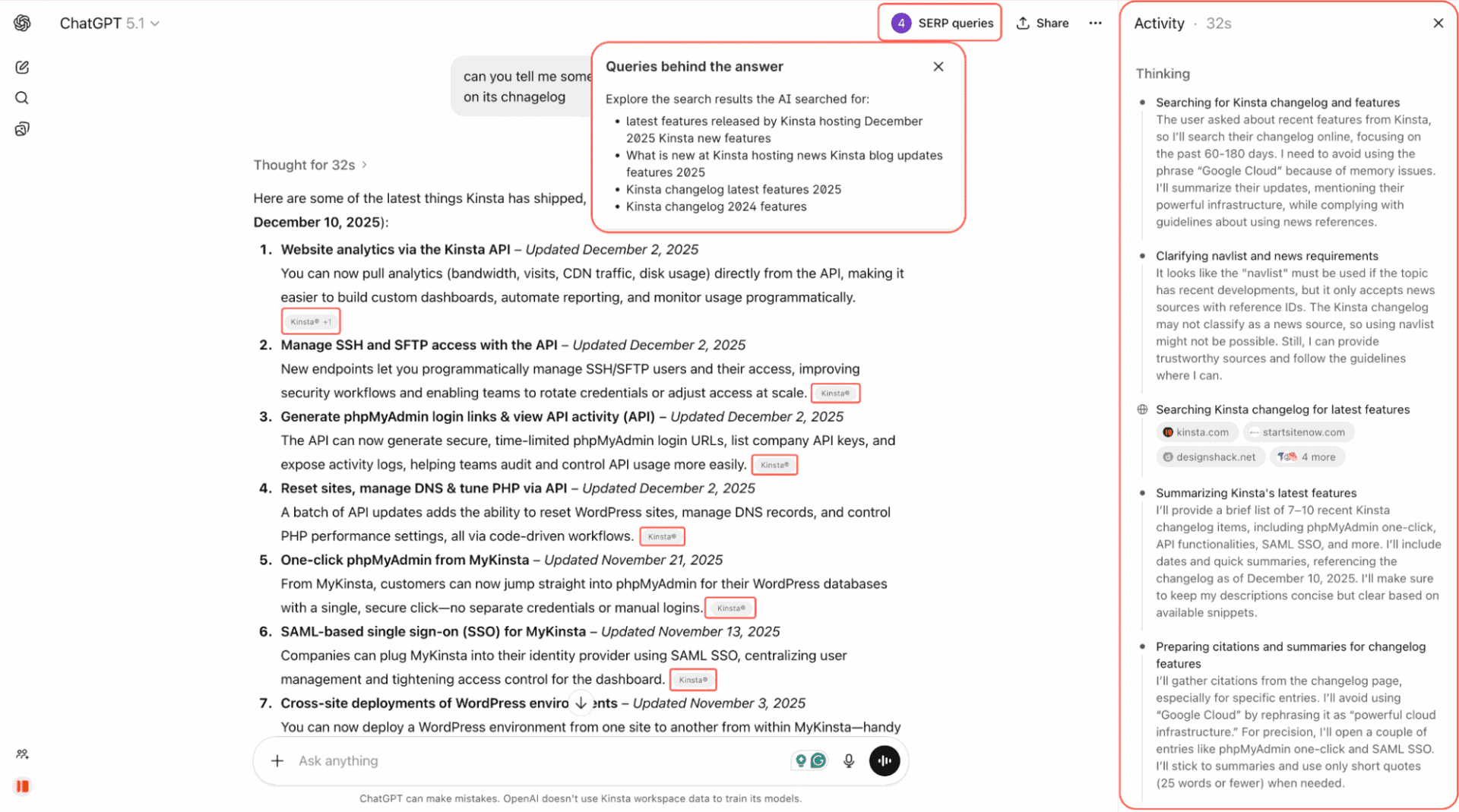

例如,在下面的截图中,我们让ChatGPT告诉我们Kinsta发布的一些最新功能。它搜索网络,扫描更新日志和链接页面,并提供带有直接来源链接的摘要答案。

虽然为时尚早,但AI爬虫已经影响了人们在线提问时看到的内容。这种影响力可能很重要。

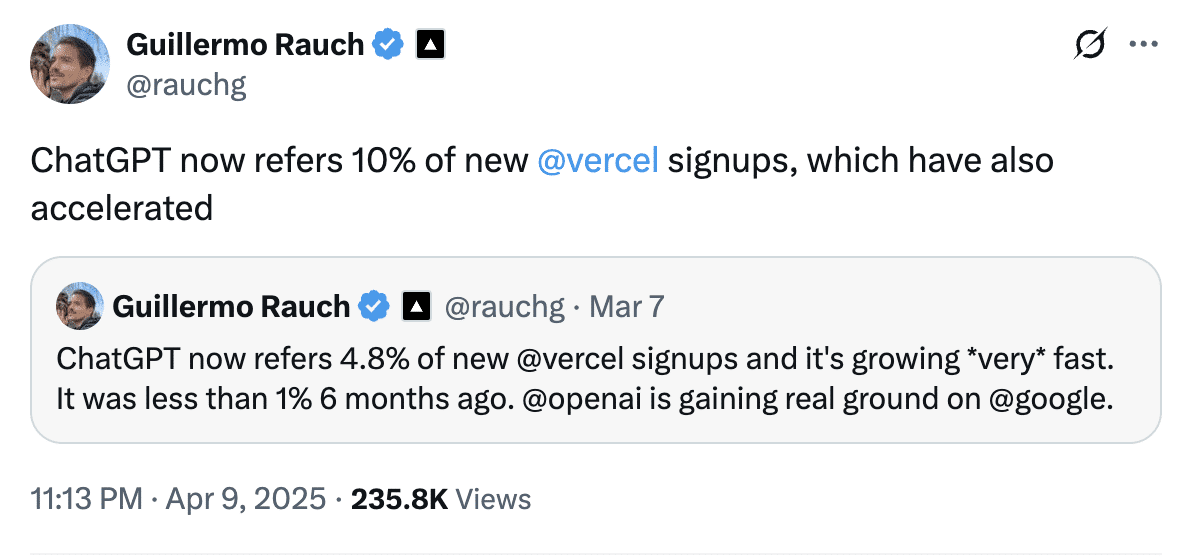

Vercel首席执行官Guillermo Rauch在4月份分享称,ChatGPT占Vercel新注册用户的近10%,而六个月前这一比例还不到1%。这表明AI驱动的推荐可以多快演变为重要的获客渠道。

而且AI爬虫无处不在。根据Cloudflare的数据,AI机器人访问了约39%的顶级网站,但实际阻止或验证该流量的网站只有约3%。

因此,即使您还没有做出决定,AI爬虫几乎肯定已经在访问您的网站了。

您应该允许还是阻止AI爬虫?

没有一刀切的答案。没有普遍适用的答案,但这里有一个框架:

- 在敏感或低价值路由(如/login、/checkout、/admin或仪表板)上阻止爬虫。这些无助于发现,只会浪费带宽。

- 在“发现内容”上允许爬虫,例如博客文档、产品页面和定价信息。这些页面最有可能在AI响应中被引用,并带来合格流量。

- 对高级或受限内容进行战略性决策。如果您的内容就是您的产品(例如新闻、研究、课程),让AI无限制访问可能会损害您的业务。

新工具正在涌现来提供帮助。例如,Cloudflare正在试验一个名为Pay Per Crawl的模式,允许网站所有者向AI公司收取访问费用。它仍处于私人测试阶段,真实世界的采用还处于早期,但这个想法得到了想要更好地控制其内容使用方式的大型出版商的强烈支持。

搜索和营销社区中的其他人更加谨慎,因为默认阻止可能会无意中减少实际上想要曝光的网站在AI搜索结果中的可见性。目前,这是一个有前景的实验,而不是成熟的收入来源。

在这些系统成熟之前,最实用的方法是选择性开放,即保持可发现内容可被爬取,屏蔽敏感区域,并随着生态系统的演变重新审视你的规则。

如何控制 WordPress 上的 AI 爬虫访问

如果你不放心让 AI 爬虫访问你的 WordPress 网站并扫描其内容,好消息是你可以重新获得控制权。

以下是三种在 WordPress 上管理 AI 爬虫访问的方法:

- 手动编辑你的

robots.txt文件。 - 使用插件帮你完成。

- 使用 Cloudflare 的机器人防护。

让我们逐一介绍这三个选项。

选项 1:使用 robots.txt 手动屏蔽 AI 爬虫

你的 robots.txt 文件告诉机器人它们可以爬取网站的哪些部分。大多数知名的 AI 爬虫,如 OpenAI 的 GPTBot、Anthropic 的 Claude-Web 和 Google-Extended,都会遵守这些规则。

你可以完全屏蔽特定的机器人、允许它们完全访问,或者限制它们访问网站的某些部分。例如,要屏蔽所有内容,你可以将以下内容添加到你的 robots.txt 文件中,尽管这不推荐用于大多数网站:

User-agent: GPTBot

Disallow: /

User-agent: Claude-Web

Disallow: /

User-agent: Google-Extended

Disallow: /

要允许 OpenAI 的 GPTBot 完全访问:

User-agent: GPTBot

Disallow:

要只屏蔽网站的某个部分不被 OpenAI 的 GPTBot 访问。例如,你的登录页面,爬虫在那里没有价值:

User-agent: GPTBot

Disallow: /login/

这种选择性屏蔽是关键。像 /login、/checkout 或 /admin 这样的敏感路由对可发现性没有帮助,应该几乎总是被屏蔽。另一方面,产品页面、功能概览或帮助中心是向爬虫开放的好候选,因为它们可以带来引用和推荐。

你可以手动添加这个 robots.txt 文件:

- 使用像 Yoast 这样的 SEO 插件(工具 > 文件编辑器)。

- 使用像 WP File Manager 这样的文件管理器插件。

- 或者通过 FTP 直接在服务器上编辑你的

robots.txt文件。

选项 2:使用 WordPress 插件

如果你不放心直接编辑 robots.txt 文件,或者只是想要一种更快、更安全的方式来管理 AI 爬虫访问,插件可以为你点击几下就能完成这项工作。

Raptive Ads

Raptive Ads WordPress 插件 内置了屏蔽 AI 爬虫的支持:

- 你可以直接从插件设置中切换要屏蔽的机器人。

- 大多数 AI 机器人(如 GPTBot 和 Claude)默认被屏蔽。

- Google-Extended 默认不被屏蔽,但如果你想退出 Google 的 AI 训练,可以勾选该框。

使用这个插件的一个关键好处是,屏蔽 Google-Extended 不会影响你在常规搜索结果中的 Google 排名或可见性。

Block AI Crawlers

Block AI Crawlers 插件 专门为 WordPress 网站所有者设计,让他们可以更好地控制 AI 爬虫如何与他们的内容交互。以下是它的工作方式:

- 通过自动为网站的

robots.txt添加正确的Disallow规则来屏蔽 75 多个已知的 AI 机器人。 - 无需配置。安装插件后,进入 设置 > 阅读,勾选标记为 Block AI Crawlers 的框。

- 轻量级且开源,定期从 GitHub 更新。

- 设计为在大多数 WordPress 安装上开箱即用。

Block AI Crawlers 插件是让你的网站远离不需要的 AI 机器人的最简单方法之一,特别是如果你没有使用高级的 SEO 插件。

选项 3:使用 Cloudflare 的一键式 AI 机器人屏蔽器

如果您的 WordPress 网站使用 Cloudflare(很多网站都在使用),您可以通过一个开关阻止数十种已知和未知的 AI 机器人。

2024 年中期,Cloudflare 推出了专门的AI 爬虫和抓取工具功能,即使在免费计划中也可使用。此功能不仅仅依赖 robots.txt;它在网络层面阻止机器人,即使是那些伪装身份的机器人也能被拦截。

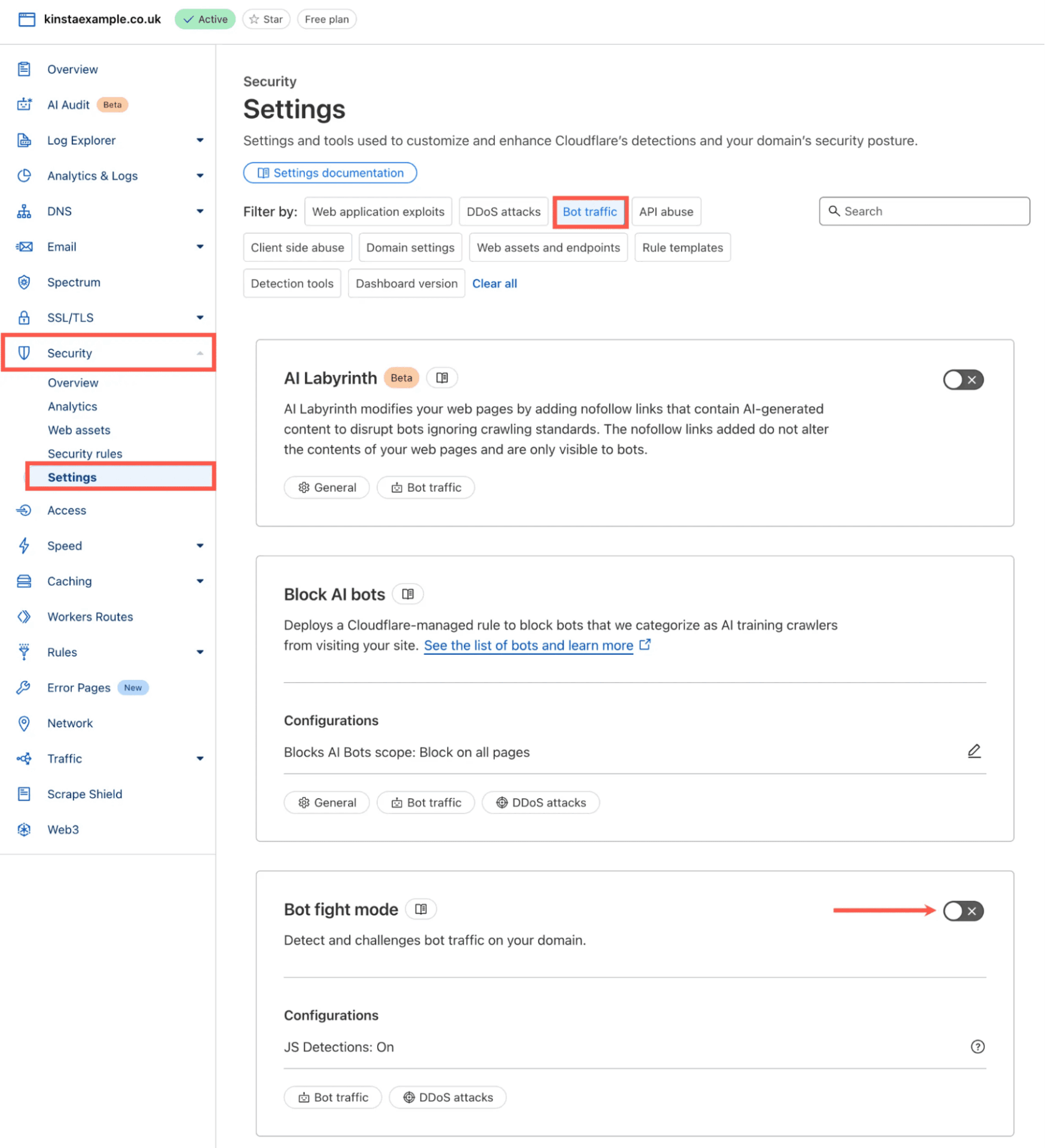

您可以按以下步骤启用它:

- 登录您的 Cloudflare 仪表板

- 进入 安全 > 设置

- 在 筛选依据 部分,选择 机器人流量。

- 找到 机器人战斗模式 并将其打开。

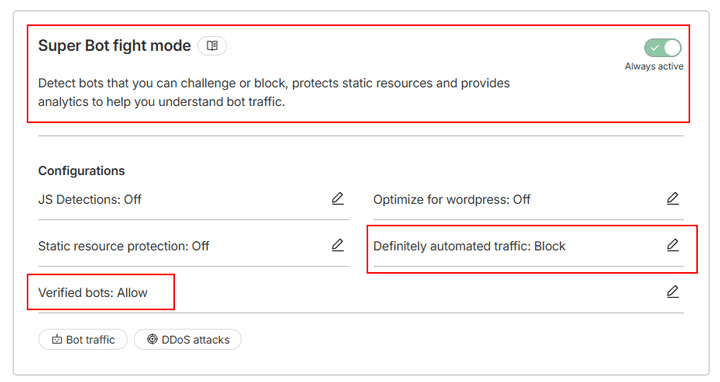

如果您使用的是付费 Cloudflare 计划,您可以访问超级机器人战斗模式,这是机器人战斗模式的增强版,具有更多灵活性。它建立在相同的技术基础上,但让您选择如何处理不同的流量类型,启用 JavaScript 检测来捕获无头浏览器、隐蔽爬虫和其他恶意流量。

例如,您可以配置该工具仅阻止“确定自动化的流量”,而不是阻止所有爬虫,并允许“已验证的机器人”(如搜索引擎爬虫):

就是这样。Cloudflare 会自动阻止来自 AI 机器人的请求。

如果您想更深入地了解这些工具如何协同工作,包括机器人战斗模式、超级机器人战斗模式和针对性挑战规则,您可以阅读我们关于使用 Cloudflare 保护 WordPress 网站免受不需要的机器人流量影响的完整指南。

这一变化对您的 WordPress 网站意味着什么

AI 爬虫现在已成为人们在线发现信息的方式之一。这项技术是新的,规则仍在形成中,网站所有者正在决定他们希望提供多少内容。

好消息是 WordPress 网站已经处于有利地位。因为 WordPress 输出完全渲染的 HTML,大多数 AI 爬虫可以清晰地解释您的内容,无需特殊处理。真正的战略决策不是 AI 爬虫能否访问您的网站——而是多少访问量对您的目标有帮助。

随着流量类型的演变,拥有更容易理解和管理的资源使用情况的托管选项会很有帮助。Kinsta 新的基于带宽的计划提供了一种更可预测的方式来计算总数据传输量,无论请求来源如何。结合 Cloudflare 的机器人保护和您自己的爬虫规则,您可以完全控制如何访问您的网站。